Дали треба да бидеме загрижени? Експерт за вештачка интелигенција ги открива 5-те начини на кои вештачката интелигенција може да ја убие човечката раса и да го изумре човештвото

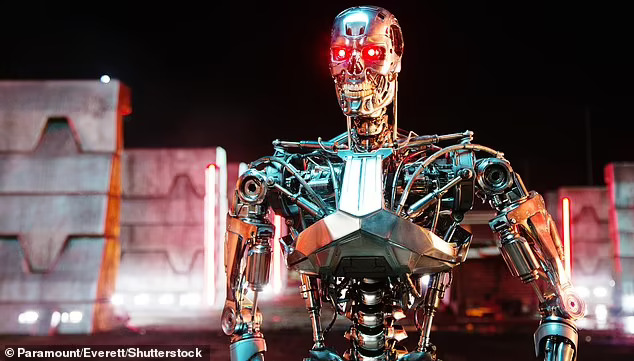

Од „Терминатор“ до „Матрикс“, роботите убијци долго време се застрашувачки главен производ на научно-фантастичните филмови.

Но, иако тие би можеле да бидат вредни за страв во кино, дали навистина треба да се плашиме од големата лоша вештачка интелигенција?

Од засилени чуми до целосно нуклеарно уништување, експертите велат дека постојат пет начини на кои вештачката интелигенција може да го донесе крајот на човештвото.

Бен Ајзенпрес, директор за операции на Институтот за иднината на животот, предупредува дека „сите катастрофални ризици од вештачката интелигенција моментално се потценети“.

Значи, ако сè уште мислите дека Апокалипсата на вештачката интелигенција не е ништо повеќе од застарен филмски заплет, прочитајте понатаму за да видите колку навистина треба да бидете загрижени.

1. Нечесната вештачка интелигенција (ВИ)

Кога размислувате за вештачката интелигенција која води кон уништување на човештвото, најверојатно роботите убијци се она што го имате на ум. Една грижа е што создаваме ВИ толку моќна што човештвото ја губи способноста да ја контролира, што доведува до несакани последици.

До неодамна ова не беше ништо повеќе од филмски сценарија и теоретска вежба за технолозите. Но, сега, со брзиот напредок што го гледаме во вештачката интелигенција, г-дин Ајзенпрес вели дека ова сценарио повеќе не изгледа толку далеку.

Тој вели: „Нечесната вештачка интелигенција, каде што вештачката интелигенција бега од човечката контрола и предизвикува широко распространета штета, е реален ризик“.

Треба да се види каде оди вештачката интелигенција, а не само каде е денес. Во последните неколку години се забележани неверојатни откритија. Но, дури и во ова најнаучно-фантастично сценарио, непријателската вештачка интелигенција сè уште нема да изгледа како Skynet на Терминатор.

Г-дин Ајзенпрес рече: „Спротивно на научната фантастика, вештачката интелигенција не мора да има чувства на свест за да стане непријател. Доволно е само да ѝ се даде на вештачката интелигенција отворена цел како „зголемување на продажбата“ за да нè постави на овој пат. Отворена цел ќе ја поттикне вештачката интелигенција да бара моќ бидејќи поголема моќ помага да се постигнат целите“.

2. Биооружје

Засега, самата вештачка интелигенција можеби всушност не е најголемата опасност – поголемиот проблем е што луѓето можат да создадат со вештачката интелигенција.

„Краткорочно, биотероризмот овозможен со вештачка интелигенција е можеби една од најголемите закани од неконтролиран развој на вештачката интелигенција“, вели г-дин Ајзенпрес.

И тој не е сам во своите грижи.

Неодамна, премиерот Риши Сунак го искористи Самитот за безбедност на вештачката интелигенција во паркот Блечли за да го вклучи алармот за биооружјата со помош на вештачка интелигенција.

Исто така, Дарио Амодеи, основач на фирмата за вештачка интелигенција Anthropic, го предупреди американскиот конгрес дека вештачката интелигенција може да им помогне на криминалците да создадат био-оружје во рок од две до три години.

Истражувачите откриле дека алатка дизајнирана за корисно откривање на лекови може лесно да се конвертира за да открие нови биохемиски токсини. За помалку од шест часа вештачката интелигенција предвиде повеќе од 40.000 нови токсични молекули – многу поопасни од постојното хемиско оружје.

Г-дин Ајзенпрес вели дека неговата загриженост е дека терористичките групи ќе можат да ги пренаменат овие алатки за да ослободат разорни чуми или хемиски напади.

„Ви е веќе способна да дизајнира токсични молекули и да создава напреден малициозен софтвер, па дури и може да помогне во планирањето на биолошки напади. Понапредните модели ќе бидат уште помоќни, а со тоа и уште поопасни во погрешна рака“, рече тој.

3. ВИ намерно се ослободува

За да се разбере зошто пуштањето во употреба на слабо разбрана компјутерска програма може да биде катастрофално, нема потреба да се шпекулира за иднината.

Во 2017 година, неповрзаните компјутерски системи ширум светот одеднаш почнаа да доживуваат необјаснети проблеми.

Најголемото индиско пристаниште за контејнери беше доведено во застој, системот за следење на радијацијата во нуклеарната централа во Чернобил беше офлајн, а банките, фармацевтските фирми и болниците наеднаш ја загубија контролата врз своите системи.

Виновникот беше вирусот NotPetya, сајбер-оружје многу веројатно создадено од руската војска за да ја нападне Украина.

Но, кога протече вирусот, тој се прошири многу подалеку отколку што очекуваа неговите креатори, што доведе до проценета штета од 10 милијарди долари.

Исто како и со биооружјата, вештачката интелигенција го зголемува капацитетот на сајбер оружјето на нови нивоа на уништување.

Загрижувачки е тоа што овој процес можеби веќе започнал.

Исто така, постои загриженост дека може и намерно да се ослободи непријателска вештачка интелигенција во светот.

Минатата година, истражувачите од Центарот за безбедност на вештачка интелигенција напишаа: „Ослободувањето на моќни вештачки интелигенции и дозволувањето да преземаат активности независно од луѓето може да доведе до катастрофа“.

Истражувачите истакнаа дека само еден месец по објавувањето на GPT-4, проект со отворен код веќе ги заобиколи безбедносните филтри за да создаде агент наложен да го „уништи човештвото“, „да воспостави глобална доминација“ и „да достигне бесмртност“.

„Наречена ChaosGPT, вештачката интелигенција состави истражување за нуклеарно оружје и испраќа твитови обидувајќи се да влијае на другите“, велат истражувачите.

За среќа, овој агент немаше можност да хакира компјутери, да преживее или да се шири, но тоа беше важно предупредување за ризиците од намерно злонамерна вештачка интелигенција.

4. Нуклеарна војна

Можеби еден од највознемирувачките стравови околу вештачката интелигенција е дека самите системи што ги градиме за да се заштитиме може да станат наше поништување.

Модерното војување се потпира на собирање и обработка на огромни количини на информации. Бојните полиња стануваат огромни мрежи на сензори и носители на одлуки, а разорниот напад може да пристигне побрзо од кога било досега.

Поради оваа причина, светските војски сега почнуваат да размислуваат за имплементација на вештачка интелигенција во нивните системи за одлучување.

Но, г-дин Ајзенпрес вели дека инкорпорирањето на вештачката интелигенција во нашите воени системи може да доведе до уште поголеми опасности, особено во случај на нуклеарно оружје.

Исто како во класичните „WarGames“ од 1983 година, користењето на вештачката интелигенција за контрола на нуклеарното оружје може да доведе до нуклеарна војна.

Тој рече: „Денешните системи за вештачка интелигенција се инхерентно несигурни, способни да донесуваат необјасниви одлуки и да „халуцинираат“. Интегрирањето на вештачката интелигенција во нуклеарните командни и контролни системи е дестабилизирачко. Една грижа е дека брзото одлучување на вештачката интелигенција може да доведе до мали грешки, на пример погрешно идентификување на авион, брзо прераснување во целосна војна“.

Штом вештачката интелигенција ќе ја направи првичната грешка, вештачката интелигенција на различни нации може да реагира една на друга побрзо отколку што било кој човек може да контролира, што ќе доведе до „блиска војна“.

„Дури и ако технички има човечки фактор во сето ова, не можеме да сметаме на носителите на одлуки дека ќе ја отфрлат потенцијално погрешната препорака за лансирање генерирана од вештачката интелигенција, со оглед на таквите егзистенцијални влогови“, заклучува г-дин Ајзенпрес.

5. Постепено обезмоќување

Г-дин Ајснепрес вели дека еден начин на кој можеме да дојдеме до крајот на човештвото како што знаеме е преку бавно, тивко, преземање.

„Нашето „Постепено слабеење на вештачката интелигенција“ ја раскажува приказната за тоа како луѓето може постепено да ја предадат контролата над нашиот свет на вештачката интелигенција, без ниту еден драматичен момент“, рече тој.

Од финансиски трансакции до правни постапки, многу задачи веќе се предадени на вештачката интелигенција.

„Со текот на времето, вештачката интелигенција ќе се интегрира во сè повеќе системи, вклучително и оние кои се клучни за нашиот начин на живот. Компаниите или политичките партии кои одбиваат да ја искористат вештачката интелигенција ќе загубат од оние што го прават тоа. Малку по малку, луѓето ќе имаат помала контрола над светот. Можеме да се најдеме на милост и немилост на вештачката интелигенција, без воопшто да сфатиме што се случува“.

За да го разбереме ризикот со кој се соочуваме, г-дин Ајзенпрес вели да не гледаме во иднината, туку кон минатото.

Тој рече: „Обезмоќувањето е стандардниот исход кога ќе се појави попаметен и поспособен ентитет; само прашајте ги неандерталците. Тие напредуваа стотици илјади години, за брзо да исчезнат кога модерните луѓе стапија на сцената“.

Г-дин Ајзенпрес завршува со цитат од Алан Туринг, основач на модемските компјутери, кој напишал во 1915 година: „Не би требало долго да ги надминеме нашите слаби моќи… Затоа во одредена фаза треба да очекуваме машините да ја преземат контролата“.

Доколку сакате добра акција или пак забегани и жестоки случки само за најхрабрите читатели, тогаш посетете го каналот Жестоко. Предупредување: Содржините може да ве вознемират!

Коментирај анонимно